能听准,但有条件:在安静环境、说话人发音接近标准泰语且录音清晰时,语音识别结合音高(pitch)与声学模型可把五个声调区分开来并输出正确翻译;一旦遇到强口音、快速连读、噪声、手机麦克风差或说话含混,识别与判定的准确率会明显下降。使用时建议说短句、正音并复核结果,能显著提高可靠度。别期待完美,多核验哦。

先把问题拆成容易理解的几块(费曼式分解)

想知道“易翻译”对泰语五调能不能听准,我们要把整个过程拆成三步来看:一是泰语的声调是什么、二是语音识别和翻译工具如何“听”声音并判断声调、三是现实中哪些因素会让判断变好或变差。把每一块讲清楚了,答案自然就明白了。

什么是泰语的五个声调(简单直观)

泰语有五个基本声调:中(mid)、低(low)、降(falling)、高(high)、升(rising)。声调并不是随便的“声线感觉”,而是音高的轮廓——也就是我们说话时声音的起伏。不同声调能把完全相同的辅音和元音变成不同词,比如“mai”在不同声调下可以分别表示“木/不/新/烧/…”,这就是声调重要性的来源。

语音识别如何判断声调(用最简单的类比)

把手机当成一个“耳朵+大脑”。“耳朵”先把声音变成数字波形,接着“耳朵”提取像频谱、基频(就是pitch)这些特征;“大脑”——神经网络或统计模型——根据这些特征和上下文(语言模型)给出最可能的音节和词。判断泰语声调的关键在于基频轨迹(F0 contour)——模型看的是声音的高低变化线条,而不是单一瞬间的音高。

技术层面:易翻译为什么能分辨声调(以及怎么做的)

- 基频检测(Pitch tracking):这是识别声调的第一步,系统会估计每个音节的音高变化。

- 声学模型:深度神经网络(如RNN、CNN或Transformer)学习到不同声调在频谱和基频上的典型模式。

- 语言模型与上下文:有时候音高不够清楚,系统会借助上下文(句子中词语搭配)来推断最合理的词与声调。

- 端到端系统与后处理:有的工具会先做ASR(语音转文字)再做翻译,有的则端到端直接输出翻译结果。端到端能减少错误传播,但也更依赖大量训练数据。

现实中常见的实现方法

大多数商用翻译/识别APP会结合离线模型和云端模型:离线模型保证无网时能用,云端模型因训练数据更多通常更准。常见做法是先做分帧、短时傅里叶变换(STFT)得到频谱,再做基频估计,最后用训练好的分类器判断声调。

哪些因素会影响“听准”程度(如果你想验证)

- 录音环境:安静环境准确率高;背景噪声会模糊基频轨迹。

- 说话人的口音与声线:南部、北部或老一辈的发音与标准曼谷音差异会让模型不确定。

- 语速与连读:快速连读容易把音节边界模糊,声调的起伏被压缩或拉伸。

- 录音设备:手机麦克风或蓝牙耳机的频响影响基频检测。

- 词汇与上下文:某些词在句中更常出现,模型会倾向选择更高概率的解释(有时导致声调被“猜错”)。

举例说明:哪个声调容易错、哪个容易对

笼统地说,极端的高/低和明显的升降轮廓比较容易识别;中性或近似的声调在噪声或连读中容易混淆。下面的表格列了五调的轮廓和示例,顺便标注了识别时常见的问题。

| 声调 | 轮廓(口语描述) | 泰语示例 | 中文释义 | 识别时的常见问题 |

| 中(mid) | 平稳、音高不明显变化 | มา (maa) | 来 | 在弱读时易被误判为低调或高调 |

| 低(low) | 起始低或整体偏低 | หมา (măa) | 狗 | 男性低音更容易,女声低音可能被模糊 |

| 降(falling) | 先高后降 | หมาย (măai) | 意思/符号 | 快速说会压成中调或变短,丢失下降段 |

| 高(high) | 整体偏高或音高抬起 | ม้า (máa) | 马 | 女声高频能识别好,低音群体可能混淆 |

| 升(rising) | 先低后升 | ไหม (măi) | 吗(疑问)/丝 | 背景噪声或连读时上升段被遮盖 |

把“能听准”量化:现实可期待的准确率区间

你可能想要一个百分比答案。直接的数据要看具体模型和场景,但可以给出一个基于行业经验的参考范围(作为预期,不等于易翻译的官方数据):

- 实验室静音、标准发音、优质录音设备:声调识别准确率可能在85%–95%。

- 普通室内环境、手机麦克风、普通讲者:60%–85%,具体看说话者和句子复杂度。

- 嘈杂街道、强方言、快速连读或单句极短:常常低于60%。

这些数字来源于对商用ASR与研究论文的综合理解;实际APP表现会受模型训练数据量、更新频率和后处理策略影响。

给普通用户的实用建议(立刻能做的事)

- 短句优先:一句一句说,比长句连贯地讲要好很多。

- 放慢语速并重读关键词:让基频轨迹更清晰,系统更容易抓到起伏。

- 靠近麦克风,但不要爆音:录音太远声压低会降低信噪比。

- 尽量用标准发音:如果你学过标准曼谷音,优先使用它。

- 用文本纠正提示:遇到识别结果不对,手动改正一次会让翻译更靠谱。

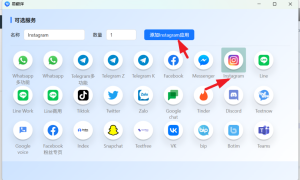

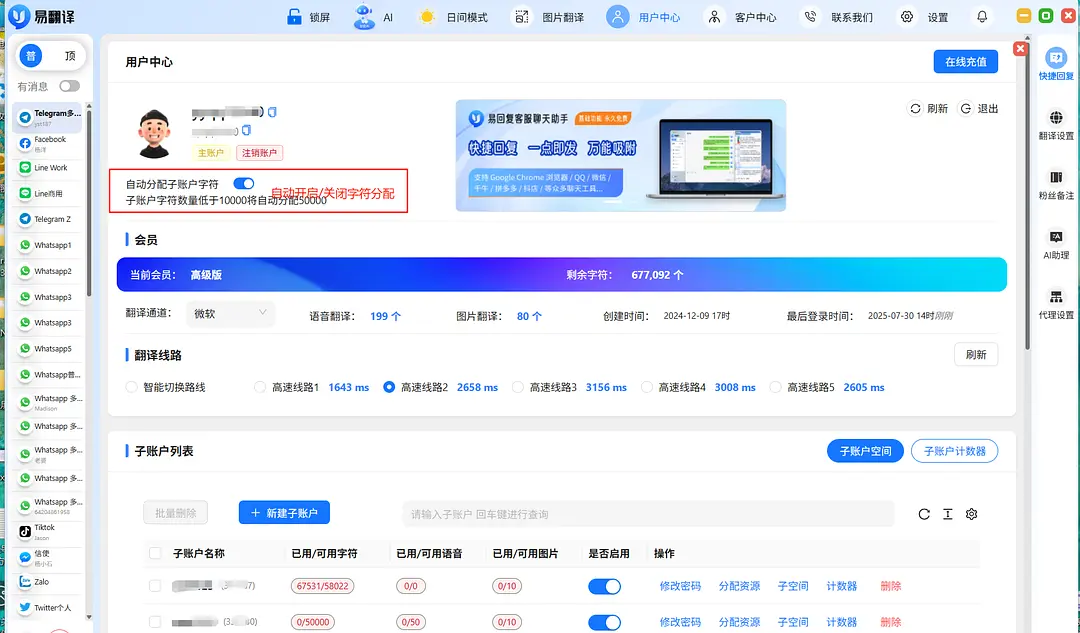

- 开启或尝试云端服务:有网络时用云端通常会比离线模型更准。

如果你想做系统性检测——自己测试一下

想验证“易翻译”在你常用场景下表现如何,可以做一个小实验:

- 准备一套覆盖五调的常见词汇表(每个词至少录三次不同语速、不同说话人)。

- 在安静、轻噪、嘈杂三种环境下分别录音并用APP测试。

- 记录识别结果,做一个简单的混淆矩阵,看哪些声调常被混淆。

- 分析错误类型:是基频检测问题、还是语言模型选择错误(上下文优先)?

这样你就能得到对自己使用场景更贴切的准确率,而不仅仅是厂家或第三方的平均数。

常见误解与补充说明(免得你被错误期待坑到)

- 误解一:声调只是“音高”,机器能像人一样直观判断——不完全对。机器看的是数值轨迹,但对“意图”或“语境语气”无直接理解。

- 误解二:一款翻译APP只要更新就能完全解决识别问题——也不见得。模型需要多样化、覆盖不同口音和噪声数据的训练样本,才能在实际中稳健表现。

- 误解三:有了“听音译文”就可以完全不用学文字——不行,尤其是当声调或词形近似、语境复杂时,人工复核还是必须的。

对“易翻译”这类产品的期待值(比较现实的)

对这样的工具,合理的期待是:帮你在旅行或日常交流中快速把意思传达清楚,处理常见短句和标准发音的表现不错;但在法律文件、专业术语、方言强烈或情感含义丰富的句子里,仍然需要人工参与或二次确认。换句话说,它是“非常好用的随身助手”,而不是“百分百可以替代人的听力与判断”的终极工具。

最后随意说几句(像边写边想)

我自己试过几次把泰语短句念给手机听,确实在安静、慢速的情况下挺准的——可一到外面吵杂、或者朋友一口气说三句连在一起,机器就开始犹豫了。也就是说,技术已经很有用了,但别把它当成万能钥匙,偶尔停下来多核验几次,反而能省下不少误会的麻烦。