易翻译在对话层面的分割,更多是把“说话的流”切成一个个可识别、可翻译的语句单元;这些单元通常依赖语音端点(说话的停顿)、自动语言检测、标点恢复以及用户的按键/触摸操作来决定。界面上会把每次识别出的发言以独立气泡或行列展示,标明原文与译文、语言标签和时间戳,用户还能手动合并或拆分不满意的段落。不同场景(单聊/群聊/现场翻译)会采用不同策略在“延迟”和“准确度”之间取舍,从而影响分割的颗粒度和实时性。

先把整体轮廓说清楚

想象一次对话像一条不断流动的河,易翻译需要把河水分成一桶桶便于搬运的小水瓢。拆分依据不是随意的,而是靠几条“绳索”——时间停顿、语言判断、说话人标识、以及用户的交互指令。明白这些绳索怎么拉开,才能理解为什么有时候一句话会被分成好几段,或者几句话被合并为一条。

易翻译对话咋分?核心维度一览

1. 时间端点(语音端点检测,VAD)

核心想法:当说话人暂停到一定程度,系统认为一句话结束并把当前语音片段送去识别和翻译。这个“暂停”不是随意设置的,一般有一个阈值(常见在300–700毫秒之间,但不同产品和场景会调整)。

- 短暂停(<300ms)通常被视为句中停顿,不分段。

- 中长暂停(300–700ms)常作为句末端点,触发识别/翻译。

- 很长的停顿(>700ms)多半被处理为明确结束、并可能触发时间戳或新发言标记。

2. 自动语言检测(Language ID)

系统会实时判断说话人使用的语言或语言变化。语言切换是分割的一条重要线索:当检测到语种从中文切换到英语时,系统往往会把这次切换作为新的单元开始。

3. 说话人识别(Speaker diarization)

在多人对话中,区分谁在说话非常关键。说话人识别会把连续语音分配给“说话者A/B/C”,并把每个说话者的发言独立为单元,方便显示成不同颜色或位置的气泡。

4. 标点与句子恢复

语音识别输出往往是连在一起的文字,随后会做标点恢复(period, comma, question mark)并按逻辑断句。标点恢复模型会依据语气、停顿、词序等把长串文字切成语义完整的句子。

5. 用户操作触发

很多时候用户可以手动控制分割:按住说话(PTT,push-to-talk)意味着一句话以按键结束;点击“翻译”按钮才开始识别;在翻译结果上点击“拆分”或“合并”来调整系统判断。这些操作会直接改变对话的呈现方式。

6. 上下文与会话状态

为了保持连贯,系统会把近期历史作为上下文,防止把一个复杂句子因为短暂停而错误拆分;但在长会话中,系统也会周期性清除或压缩上下文以节省资源和避免翻译偏移。

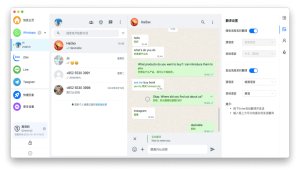

界面上会如何呈现这些分割

从用户角度,分割通常体现在:

- 独立的气泡或行:每个识别/翻译单元一个块。

- 语言标签或国旗小图标:标明原话语种与译文目标语。

- 时间戳:显示发言时间,帮助追溯语境。

- 播放/回放按钮:能听回原声并对齐显示文字。

- 编辑功能:手动拆分、合并、重译或修改原文。

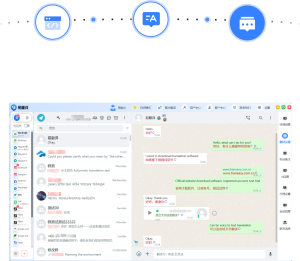

| 模式 | 分割原则 | 延迟(典型) | 适合场景 |

| 实时互译 | 短暂停即端点 + 语种切换 | 低(几百毫秒到1s) | 旅游对话、服务咨询 |

| 双语对话记录 | 说话人识别 + 标点恢复 | 中(1–3s) | 远程会议、访谈 |

| 文本/拍照翻译 | 以句子/段落为单位 | 高(即时) | 读取说明书、菜单 |

为啥有时系统会“错分”或“合并过度”

说白了,就是延迟和准确率这两个目标在拉扯。要更快就要短阈值、频繁提交,结果容易把一句话切成许多碎片(过分切分)。要更准确,就等更多信息,阈值调高,会把多句合并成一大段(欠切分)。另外,噪声、口音、叠话(多人同时说)也会干扰:系统可能把两个同时说的声音当成一个发言,或者把停顿当作句末。

常见情形与对应表现

- 连续讲了很长的一句话:系统可能分成几块,特别在中间有短暂停的地方。

- 多人交替快速发言:分割颗粒度可能更细,且说话人识别会更吃力。

- 突然切换语言:通常会被当做新单元开始。

如果你想让分割更符合预期,可以怎么做

- 说话时有意识地在句子结尾稍作停顿(0.4–0.6秒),让端点更清晰。

- 使用按键讲话(PTT)或点按翻译按钮,明确起止。

- 尽量避免多人重叠发言,或使用分发言顺序(轮流说)。

- 在噪声环境用耳机或靠近麦克风,减少干扰。

- 遇到识别错误,手动拆分/合并并重译,系统通常会记住偏好。

背后的技术——用最少的术语把过程说清楚

把流程分成几个阶段:录音采集 → 语音活动检测(VAD)做端点 → 实时ASR(流式识别)输出部分或最终结果 → 标点恢复与句子分割 → 语言识别与说话人标注 → MT(机器翻译)生成译文 → 前端展示与用户交互。每一步都有权衡,特别是“流式ASR+端点”决定了实时性,“标点恢复”决定可读性,“说话人识别”决定界面布局。

一些常用算法/模型名字(不必全部记住,但知道它们存在)

- VAD(Voice Activity Detection)

- ASR(Automatic Speech Recognition)——常见的流式/非流式模型

- Diarization(说话人分离与聚类)

- Punctuation Restoration(标点恢复神经网络)

- LangID(语言识别)

- MT(Neural Machine Translation)

隐私与数据处理要点

真实产品里,这些语音和文字可能在本地或云端处理。云处理能换来更强的模型和更准的分割,但也意味着数据短期上传。许多翻译应用会提供“本地离线引擎”或“对话不留痕”选项,或者明确保存历史的开关。使用前最好看权限说明,注意是否允许导出对话记录或长期存储。

举个生活化的演示流程(带点细节,方便想象)

场景:你在机场与外籍工作人员用易翻译对话。

- 你按住按钮说:“请问登机口在哪里?”(按键结束触发端点)→ 系统把这段作为单元,ASR识别并马上显示中文原文与英文译文,界面出现一个独立气泡。

- 工作人员回答:“Gate 12, straight ahead and then left.”(说话人变化,LangID检测英语)→ 语音被识别为一个单元,系统显示英文和中文译文,气泡位置在另一侧并带有语种标签。

- 你追问:“能不能帮我看下登机时间?”(短暂停后)→ 新单元。若你没有停顿,系统有时会把追问合并到前一句,译文会显得不够对焦。

- 出现嘈杂或多人说话时,系统可能把几个人的声音混在一起,这时你需要让每个人轮流发言或调整麦克风位置。

常见疑问速答(像在和你边聊边想)

- Q:一句话被拆成很多碎片该怎么办?

A:通常可以手动合并或稍微把句子讲完再停顿,或者使用按键结束发言。 - Q:为啥翻译有延迟?

A:因为系统在等待端点或上下文以提高翻译准确率,实时模式和最终模式会有不同延迟。 - Q:能修改已识别的原文再翻译吗?

A:绝大多数应用支持编辑原文后重译,这对纠正断句和专有名词特别有用。

对开发者或高级用户的小建议(如果你想更进一步)

- 在有重叠说话(overlap)的场景,考虑结合声源定位(beamforming)或使用外接麦克风阵列。

- 为不同场景分别调整VAD阈值:会议模式偏长阈值,旅游/即问即答模式偏短阈值。

- 把“短语缓存”与“最终句子”分离,界面可以先显示部分结果,再更新为最终结果,减少用户等待焦虑。

说到这里,差不多把易翻译在“对话如何分割”这件事上常见的做法、原理、可能出现的问题以及应对方法都梳理了一遍。真正使用时,多试几次设置和场景,会更快找到适合你习惯的分割方式——有点像调收音机频率,总要微调几下才正好。就先写到这儿,等你实测遇到具体怪异情况我们再一起拆解。